-

Публикаций

37 -

Зарегистрирован

-

Посещение

Посетители профиля

Блок последних посетителей выключен и не отображается другим пользователям.

Достижения Denkof

-

Модуль UniXML - модуль выгрузки в XML формате + импорт из XML [Поддержка]

Denkof ответил в теме пользователя Exploits в Модули обмена данными

Буду вдячний за будь-які коментарі та поради. Може в когось є ще ідеї. -

Модуль UniXML - модуль выгрузки в XML формате + импорт из XML [Поддержка]

Denkof ответил в теме пользователя Exploits в Модули обмена данными

Дякую. Так, варіант такої реалізації також розглядали, але тут інша проблема виникає. На пром (і не тільки) товарка льється в три канали, з різними неймами, описом, тощо. Відповідно для кожного каналу формуємо окремий фід з конкретними налаштуваннями. Якщо дробити фіди - це призведе до ускладнення адміністрування. Наприклад для коригування будь-якого елементу треба буде виконувати налаштування у всіх фідах для одного каналу. Тобто подвоює а то і потроює роботу по налаштуванню фідів + викликає людський фактор контент-менеджера, наприклад: в одному з фідів, котрий відповідає за першу групу товарів - додали характеристику та перейменували за потрібними вимогами, в другому - дадали але забули перейменувати, а в третьому взагалі не додали. Тому було бы круто реалізувати у додатку можливість задавати максимальний розмір xml файлу, або максимальну кількість товарів у фіді. Типу як реалізовують sitemap. Розумію що це добрячий шмат роботи, та лишу тут як "хотелку" може з часом стане необхідністю та буде реалізовано вами в рамках розвитку проекту. -

Модуль UniXML - модуль выгрузки в XML формате + импорт из XML [Поддержка]

Denkof ответил в теме пользователя Exploits в Модули обмена данными

Доброго дня. Нажаль не знайшов відповіді на своє питання пошуком, тому звертаюсь тут. Маю проблему при генерації файлу для prom.ua. Наразі все працює справно, але з часом файл експорту xml виріс і важить бульше 180МБ Пром, відповідно не хоче його імпортувати. Звісно, розмір можна оптимізувати шляхом виключення опису, характеристик, чи якихось інших данних, проте цього не хочеться. І навіть якщо піти цим шляхом, то додаючи нові товари вже скоро знов отримаємо ту саму проблему. Підкажіть будь ласка, чи можна файл ділити в автоматичному режимі на частини? Чи може хтось знає шлях вирішення питання? Дякую. -

Ясно, спасибо за ответ. Получается штатными средствами модуля от дублей не избавиться. Соответственно нужен какой-то дополнительный обработчик, который умеет проверять фото на дубли. Я вышел из ситуации следующим образом: сначала заливаю товары, но без фоток, Затем загружаю фотки каким-нибудь другим сервисом. Например, csv price - я хз какие у него там алгоритмы, но загружает по 1 фотке при любом количестве повторов и дубли не создает. Или собираю все что нужно Connetnt Downloader а потом физически гружу на сервер. Кому нужно подробнее - пишите в лс., расскажу детальнее, чтобы не флудить тут.

- 13 628 ответов

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

-

Да, нужно именно этого достичь. Жаль. Хм, странно, как же перезаписываются файлы у некоторых пользователей? Или это скорее баг а не какая-то конструкция обработки данных?

- 13 628 ответов

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

-

Подскажите пожалуйста. Никак не могу решить проблему. Ищу по ветке, вроде и инфа есть относительно этого вопроса, и инструкцию уже который раз перечитываю, не а решения не нахожу. Постановка вопроса: парсер разбирает хмл файл, граница для картинки = тег имеж с хмл файла. Парсер скачивает фотки на сервер, и (как и у всех) куча фоток с одинаковым названием. Вопрос: как перезаписывать фотки с одинаковым названием? Т.е. в ветке есть сообщения польователей, которые пишут что у них, как раз, перезаписываются фотки с одинаковым названием, и они пытаются от этого избавиться. А мне как раз этого нужно достигнуть. Но как? В одном из постов автор модуля пишет, что есть два файла 1.png и 1.png - одинаковые фото или нет - в моем случае фото одинаковые, т.е дубли, т.е. должны быть перезаписаны один поверх другого сколько бы такой повтор не встречался. Как перезаписывать загружаемые изображения с одинаковым названием? Ткните меня носом пожалуйста, не вижу как решить и все.

- 13 628 ответов

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

-

Добрый день. При сохранении ссылки в поле "ссылки на товары" - половина ссылки обрезается. Что и приводит к невозможности загрузить код страници при парсинге. Перелистал тему, нашел пару умоминаний о том, что база обрезает ссылки а не модуль. Длинна ссылки к сохранению в моем случае 504 символа. Подскажите пожалуйста как поправить? Если изменить в базе ограничение на длину символов, то в какой таблице и каком поле? Спасибо.

- 13 628 ответов

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

-

Модуль UniXML - модуль выгрузки в XML формате + импорт из XML [Поддержка]

Denkof ответил в теме пользователя Exploits в Модули обмена данными

Добрый день. Подскажите пожалуйста, знающие люди такое: пользую в UniXML при генирации фида, описание товара генерируется из полей p.name, pd.description, .... и еще нужно прикрутить к описанию на лету текстовые инструкции и кусок кода с видеообзором, но эти данные лежат совсем в другой таблице (oc_oct_extra_tabs). Можно ли, и как подгрузить средствами модуля, в описание при его генерации определенное поле из другой таблицы? В темене не нашел, если пропустил - ткните меня носом пожалуйста -

Модуль UniXML - модуль выгрузки в XML формате + импорт из XML [Поддержка]

Denkof ответил в теме пользователя Exploits в Модули обмена данными

Пока писал - сам нашел Спасибо. Вопрос снят. Кому интересно как удалить: заходим в "структура и системные настройки", затем жмем в верхней част окна "удалить фид" -

Модуль UniXML - модуль выгрузки в XML формате + импорт из XML [Поддержка]

Denkof ответил в теме пользователя Exploits в Модули обмена данными

Подскажите как удалить фид? Перятянуть в корзину - перетягивается. А удалить вовсе как? -

[Поддержка] OCDEV.pro - Мультиязык SEO PRO, код языка в url и правильный hreflang

Denkof ответил в теме пользователя ocdev_pro в SEO, карта сайта, оптимизация

Как решили проблему? У меня сейчас та же проблема.- 287 ответов

-

- языки

- мультиязык

- (и ещё 10)

-

Посмотрел, увеличил время запроса до 60 сек. Ситуация прежняя загрузить весь код не удалось. В то же время вижу в логах Что при увеличеном времени выполнения запроса загрузилось больше данных чем до этого. было "397451 out of -1 bytes received" стало "2234884 out of -1 bytes received" Судя по количеству загруженых байт за эти 60 сек. загружается до 30 МБ данных, а у меня файл 55МБ т.е. теретически мне нужно увеличить время запроса до 120 секунд и тогда процес должен завершиться успешно, так?

- 13 628 ответов

-

- 1

-

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

-

Спасибо. Читаю, пробую.

- 13 628 ответов

-

- 1

-

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

-

Здравствуйте. Подскажите пожалуйста как исправить ошибку "Operation timed out after 15004 milliseconds with 355460 out of -1 bytes received" Ошибка возникает при использовании Обработчика xml. ------------------ Есть xml файл, который я пытаюсь обработчиком разделить на товары для дальнейшего парсинга. 1. Если в оработчике xml загрузить код этого же файла и нажать "предпросмотр" - то в предпросмотре все работает корректно и код страницы корректно разделяется на товары. 2. Если в обработчике нажать "пуск" то процесс обработки запускается и спустя 15 секунд выводится сообщения "Парсинг окончен, файл успешно поделен на товары" но ссылки на сами товары не появляются в списке ссылок, а во вкладке "логи" регистрируется вышеуказанная ошибка. Я так понимаю это происходит потому, что я пытаюсь распарсить слишком большой фай и модулю не хватает времени на обработку. В то же время если попробовать распарсить любой дургой файл поменьше размером, то все отрабатывается корректно (файл делится на товары, создаюттся ссылки и помещаются в очередь сканирвоания) Подскажите как такую проблему исправить?

- 13 628 ответов

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

-

Спасибо всем, кто откликнулся на мой вопрос и помогал в решении задачи. Решение все же нашлось, во всяком случае пока что работает. Решил отписаться о решении, может кому-то будет полезно. Задача стояла парсить текущие цены с донора и лить их в базу другого магазина с наценкой. Сайт для сбора цены требовал авторизацию. Проблема заключалась в том, что используя авторизацию методом POST, модуль авторизовался только 12 часов после чего авторизация слетала. Пока пытался решить задачу выяснилось такое: - при смене браузера или сбросе кеша менялось значение rsa_data в заголовках запроса - при каждой новой авторизации менялись куки - авторизация методом POST срабатывала, лишь тогда, когда в разделе "настройка запросов" были добавлены куки. - автоматическая авторизация работала только 12 часов. - с какой-то периодичностью менялось значение ssid Проблем была решена следующим образом: отследил время активной сессии, для этого залогинился в браузере и оставим открытую вкладу периодически поглядывая разлогинело меня или нет. Спустя 12 часов браузер написал "время сессии завершено из-за отсутствия активности ...." и еще чего-то там. Т.е. меня разлогинело потому что браузер "не проявил активности". Соответственно нужно было всего лишь проявить активность. Т.к. задача моего проекта заключается в актуализации цены - я сменил частоту обновления и добавил задачу в планировщик с периодическим запуском через 8 часов. т.е. с таким интервалом, что бы сессия никогда не истекла и всегда оставалась активной. Не знаю на сколько рабочий вариант и долго ли проживет такое решение, но пока что 5 дней полет нормальный.

- 13 628 ответов

-

- 2

-

-

- simplepars

- парсинг товаров opencart

- (и ещё 15)

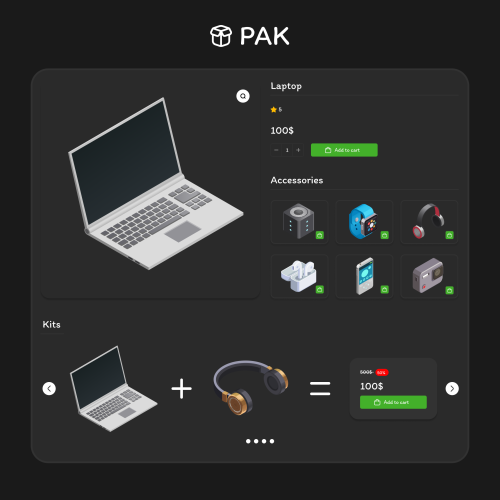

Останні розширення

-

-

SP Cool Timer Автор: spectre

SP Cool Timer Автор: spectre -

Все товары магазина Автор: kJlukOo

Все товары магазина Автор: kJlukOo -

-

Список Заказов PRO Автор: Parallax

Список Заказов PRO Автор: Parallax